本文共 1489 字,大约阅读时间需要 4 分钟。

作者:Neshoir

大数据环境搭建是一项比较复杂的工作,因为其依赖的大数据基础平台组件较多,导致很多基础薄弱的伙伴在搭建环境时遇到各种不顺,索性我们定制化了两个一键部署包产品,产品包里包含了虚拟机系统,hadoop组件,hbase组件,spark组件等。定制化的产品包的好处就是,虚拟机系统已经内置了一些依赖库或环境,hadoop等组件已配置好相关的属性。所有的部署过程都编写了自动化部署的脚本,小伙伴只需要按下面的步骤进行,即可体验全套的大数据产品。

一、产品包下载

目前在CentOS 7.5和Ubuntu 16.04系统上做了定制化及优化。产品包里有虚拟机操作系统和一键安装包。注:如果在其他Linux系统上安装部署,必须安装ssh服务,软件版本微调,需要在脚本里替换软件的名称。提取码:xujb

二、虚拟机环境准备(以centos为例)

-

解压centos-7.5.rar包,复制三份。

-

用VMware(12.5以上版本)打开三台centos系统。

-

分别用root用户登录,密码为test。

-

用命令:ifconfig,查看三台机器的ip,建议将其ip配置为固定ip。

-

由于三台机器复制的名称是一样的,分别将三台机器的名称改为 ,,。命令:

hostnamectl set-hostname master.com

三、onestep一键部署包配置

- 将onestep.tar包上传到master.com机器的/home目录下,并解压

tar -xvf onestep.tar

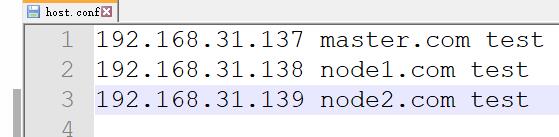

- 编辑onestep/conf/host.conf文件,新增各节点机器信息,格式:机器ip 机器名称 root用户密码

- 编辑onestep/conf/init.conf文件,设置安装用户,软件,路径等,信息如截图,注:不需预先创建用户

-

准备脚本的执行,检查bin和expect目录所有文件,是否有执行权限,顺利安装成功会显示“初始化完毕!”

# 如果没有权限,赋予权限 chmod 777 * # root用户下执行准备脚本,主要安装expect,ntp同步时间,关闭防火墙,安装jdk bin/01preinstall.sh

-

另外两台机器也会安装,登录到node1.com机器,验证时间同步服务和jdk。

# 验证时间同步服务ntpstat# 切换到supermap用户,验证jdksu supermap #输入密码java -version

四、节点机器之间安装ssh服务

在master.com机器上,切换到supermap用户,执行如下脚本:

su supermap #输入密码 bin/02installssh.sh #安装ssh服务

五、安装各组件包

在master.com机器上,切换到supermap用户,执行如下脚本:

su supermap #输入密码 bin/03installSoft.sh #安装hadoop,hbase,spark等组件,需要耗时几分钟

六、验证各个组件

执行命令 ./start_all.sh 脚本,启动所有组件

- hadoop组件的ui地址:

- hbase组件的ui地址:

- spark组件的ui地址:

至此大数据组件的快速部署完成,可以用spark组件或者iServer进行大数据分析任务。注:iServer可以配置集群,iServer开启分布式服务可以支持外部的spark standalone以及spark on yarn模式,具体配置参考iServer开启集群配置文档和iServer开启分布式服务相关博客。

转载地址:http://mjvxi.baihongyu.com/